IA et RH : ce que peuvent (et ne peuvent pas) faire les recruteurs avec ChatGPT, Gemini & autres agents intelligents

L’intelligence artificielle est désormais au cœur des réflexions RH. Rédaction d’offres d’emploi, tri de CV, évaluation de candidats : les outils comme ChatGPT, Gemini ou les agents IA promettent gain de temps et efficacité. Mais derrière l’enthousiasme, une réalité s’impose : tous les usages ne sont pas légaux. L’AI Act européen et le RGPD posent un cadre strict. Alors, que peuvent faire les recruteurs avec l’IA, et où se trouvent les lignes rouges à ne pas franchir ?

Ce que l’AI Act interdit formellement

L’AI Act classe certaines pratiques RH comme à risque inacceptable. Cela signifie qu’elles sont purement interdites, quel que soit le contexte ou l’outil utilisé.

Ce que les recruteurs peuvent faire (et comment)

De nombreux usages restent tout à fait légaux. L’important est de s’assurer que l’IA n’influence pas directement une décision sans encadrement, et que les données des candidats soient traitées avec prudence.

Les usages à haut risque : possibles, mais très encadrés

L’AI Act désigne comme « à haut risque » les outils qui participent directement à une décision RH ayant un impact significatif sur la personne (rejet de candidature, classement, promotion…).

⚠️ Cas typiques d’usage à haut risque :

- Tri et scoring de CV : dès qu’un outil classe, filtre ou pré-sélectionne, il est concerné.

- Matching de profils : suggestions automatisées de candidats à interviewer.

- Tests psychométriques ou de personnalité via IA : notamment si l’outil infère des traits à partir de comportements ou de langage.

- Entretiens vidéo augmentés : si l’outil va au-delà de la transcription et tente d’analyser des micro-expressions ou le ton de voix.

Dans ces cas, plusieurs conditions doivent être réunies :

- Marquage CE de l’outil,

- Documentation technique et journalisation des actions,

- Supervision humaine active (le RH doit pouvoir comprendre et contester les suggestions de l’IA),

- Réalisation d’une analyse d’impact RGPD (DPIA) avant le déploiement.

Ce que dit le RGPD : droits des candidats et devoirs des RH

Le RGPD s’applique dès qu’il y a traitement de données personnelles. Or en recrutement, c’est toujours le cas. Deux obligations sont essentielles à retenir pour les recruteurs.

D’abord, le principe de transparence impose d’informer clairement les candidats lorsque l’IA intervient dans le processus. Ils doivent savoir que leurs données sont analysées, dans quel but, et selon quelles logiques (même générales).

Ensuite, l’article 22 du RGPD interdit qu’une personne soit soumise à une décision automatisée (ex : rejet de candidature) sans intervention humaine significative. Cela signifie qu’une IA ne peut jamais trancher seule. L’humain doit comprendre, valider, et pouvoir rectifier si besoin.

Le RGPD impose aussi de ne collecter que les données strictement nécessaires à la finalité déclarée (excluant donc les réseaux sociaux, comportements privés, etc.) et de les protéger efficacement. Copier un CV dans un outil IA non sécurisé peut entraîner une fuite de données grave.

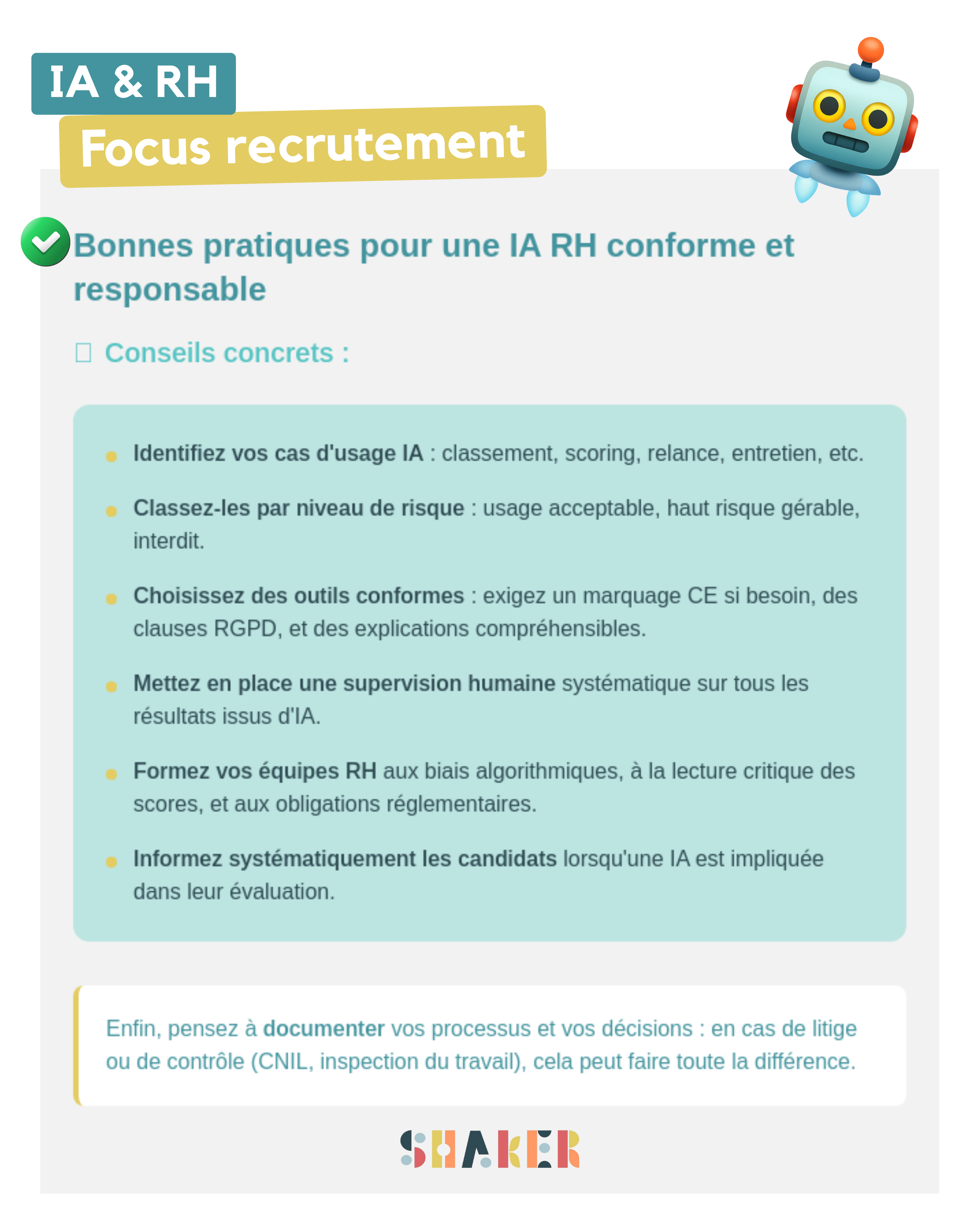

Bonnes pratiques pour une IA RH conforme et responsable

Pour intégrer l’IA en RH sans faux pas, il est recommandé d’adopter une approche structurée.

Conclusion

L’intelligence artificielle est une formidable alliée des RH… à condition d’en faire un usage éthique, transparent et maîtrisé. L’AI Act et le RGPD ne visent pas à freiner l’innovation, mais à garantir que les décisions RH restent humaines, équitables et explicables. En 2026, il ne suffira pas d’avoir une IA performante : il faudra qu’elle soit responsable, traçable et légale. Pour les recruteurs, le véritable enjeu est là